![]() , (12)

, (12)

где ![]() – различные плотности распределения вероятности. При статистической независимости X, Y имеем

– различные плотности распределения вероятности. При статистической независимости X, Y имеем ![]() , следовательно

, следовательно ![]() .

.

Формулы (11) и (12) принимаются как различные определения информации. Из формулы (9) следует, что информацию, определенную по формуле (11), можно назвать случайной энтропией [2], а энтропию ![]() – средним значением информации I(X/Y).

– средним значением информации I(X/Y).

В каждом из этих двух определений (формулы (11), (12)) содержатся следующие общие свойства информации: информация положительная величина (I > 0) и определена при наличии некоторого условия, асимметрии (![]() ). Учитывая это мы можем принять информацию I как определяющую переменную, обладающей двумя указанными свойствами, независимо от способа ее определения. Далее установим дополнительные ее свойства – существование значений определяющих случайную (локальную) и среднюю (глобальную) энтропии как границы интервала нарушения симметрии – самоорганизации.

). Учитывая это мы можем принять информацию I как определяющую переменную, обладающей двумя указанными свойствами, независимо от способа ее определения. Далее установим дополнительные ее свойства – существование значений определяющих случайную (локальную) и среднюю (глобальную) энтропии как границы интервала нарушения симметрии – самоорганизации.

Энтропия непрерывного сигнала

Строго говоря, энтропия непрерывных сигналов равна бесконечности, так как бесконечны и количество возможных сообщений (ансамбль сообщений является континуумом), и его логарифм. Тем не менее, попробуем обобщить понятие энтропии дискретного сигнала на непрерывный сигнал.

Представим непрерывный сигнал в виде непрерывной случайной величины х. Плотность вероятности которой равна р(х) и заменим его соответствующим дискретным, введя процесс квантования (см. рис. 2). Плотностью вероятности, или плотностью распределения вероятностей случайной величины х называется предел отношения вероятности попадания величины х в интервал (х – ∆х/2, х + ∆х/2) к ∆х при ∆х → 0.

Тогда вероятность к-ого состояния определяется как

![]() .

.

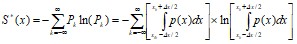

Энтропия непрерывного квантованного сигнала запишется в виде:

.

.

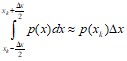

При достаточно малых ∆х и гладкой функции р(х) можно считать, что (теорема о среднем)

.

.

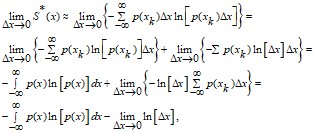

Тогда в пределе при стремлении ∆х к нулю получим энтропию исходного непрерывного сигнала:

(13)

(13)

так как ![]() .

.

Как и следовало ожидать, при ∆x → 0, энтропия квантованного сигнала → ∞. На первый взгляд, полученный результат может показаться весьма обнадеживающим: если энтропия сигнала неограниченно велика, значит с помощью него можно передавать неограниченное количество информации! Для этого достаточно лишь снять неопределенность, которую он априорно заключает в своем состоянии. Но что значит полностью снять неопределенность? Это значит получить абсолютно точный отсчет значения принятого сигнала. Но ведь этого-то и нельзя осуществить в реальных случаях. Непрерывный сигнал всегда воспринимается приближенно, с ограниченной точностью.

Таким образом, непрерывные сигналы не имеют абсолютной меры энтропии. Поэтому для них вводят понятие относительной энтропии, то есть определяют энтропию непрерывного сигнала х относительно другого непрерывного сигнала, например, x′.

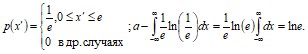

В качестве эталона чаще всего выбирается непрерывный сигнал x′, имеющий равномерный закон распределения в интервале е. Формула (13) для такого сигнала перепишется в виде

![]()

так как

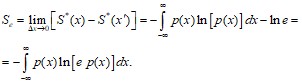

Неопределенность непрерывной величины х характеризуется числом, к которому стремится разность энтропий x и x′:

Если положить е = 1 (т. е. стандартная величина (эталон) имеет равномерный закон распределения в единичном интервале), то формула примет вид

![]()

Следует помнить, что это неабсолютная мера энтропии непрерывного сигнала. Это – относительная энтропия, где за стандарт взято равномерно распределённая в единичном интервале величина. Иногда её называют дифференциальной е - энтропией. Если выбрать другой закон распределения значений сигнала х', то выражение для относительной энтропии сигнала х также примет другой вид.

Относительная энтропия непрерывного сигнала (или сообщения) (ОЭНС) обладает свойствами, во многом аналогичными свойствам энтропии дискретных сигналов. Но есть и различия. Например, энтропия дискретного сигнала зависит лишь от вероятностей и не зависит от самих значений сигналов (можно сказать, что она зависит от закона распределения сигнала лишь частично). ОЭНС в общем случае зависит от закона распределения почти полностью. Это «почти» – намек на исключение, которое оставляет лишь независимость энтропии от постоянной составляющей сигнала.

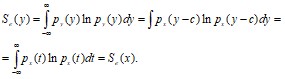

Итак, сформулируем первое свойство ОЭНС: ОЭНС не изменится, если к сигналу прибавить неслучайную величину с.

Действительно, если распределение значений сигнала х равно ![]() , то распределение сигнала у=х+с равно

, то распределение сигнала у=х+с равно ![]() и энтропия сигнала у определяется выражением

и энтропия сигнала у определяется выражением

Экстремальные свойства энтропии непрерывных сигналов. Пусть задан какой-то ансамбль сообщений или сигналов, о котором известны некоторые параметры. Например, пределы изменения, дисперсия, математическое ожидание.

Напомним, что для приближенного описания случайной величины вводят числовые характеристики – так называемые моменты. Начальный момент первого порядка называется математическим ожиданием [4]:

![]() ,

,

где р(х) – функция распределения случайной величины. Для дискретных случайных величин,

![]() ,

,

где р(хi) – вероятность появления случайной величины ![]() .

.

Математическое ожидание характеризует центр рассеивания значений случайной величины.

Центральный момент второго порядка называется дисперсией

![]()

![]() .

.![]()

Дисперсия характеризует степень рассеивания возможных значений случайной величины около её математического ожидания. Корень у =![]() называется квадратичным отклонением.

называется квадратичным отклонением.

Требуется подобрать такой закон распределения этого ансамбля, при котором энтропия была бы максимальной. Можно дать следующую физическую интерпретацию этому принципу максимальной энтропии: требуется создать помеху каналу связи противника таким образом, чтобы обеспечить в нем максимум неопределенности. Очевидно, при заданных параметрах наилучший эффект будет достигнут, если выбрать такой закон распределения помехи, при котором энтропия принимает максимальное значение.

Пусть задана ограниченная на ![]() непрерывная случайная величина с неизвестной плотностью распределения

непрерывная случайная величина с неизвестной плотностью распределения ![]() причем

причем

![]() . (14)

. (14)

Требуется найти аналитическое выражение для ![]() , которое дает максимум энтропии, задаваемой функционалом

, которое дает максимум энтропии, задаваемой функционалом

![]() .

.

Для решения можно использовать один из методов оптимизации при решении задачи нелинейного программирования – метод неопределенных множителей Лагранжа.1

Составляем функционал

![]() .

.

Берем частную производную по ![]() и приравниваем ее к нулю (знак интеграла в силу непрерывности подынтегральной функции можно отбросить):

и приравниваем ее к нулю (знак интеграла в силу непрерывности подынтегральной функции можно отбросить):

![]()

тогда

![]() . (15)

. (15)

|

Из за большого объема этот материал размещен на нескольких страницах:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 |