2. Пересечением двух событий А и В называется событие С = А*В, состоящее в осуществлении одновременно обоих событий. Например, оценка "отлично" С поставлена студенту одновременно за два правильных ответа А и В на вопросы экзаменационного билета.

3. Дополнением или логическим отрицанием события А называется событие В = ![]() (не А), состоящее в том, что событие А не произошло по результатам опыта или наблюдения. Например, событие А – экзамен сдан, тогда В =

(не А), состоящее в том, что событие А не произошло по результатам опыта или наблюдения. Например, событие А – экзамен сдан, тогда В = ![]() – экзамен не сдан. Событие В называется противоположным по отношению к событию А.

– экзамен не сдан. Событие В называется противоположным по отношению к событию А.

События А, В, С... образуют полную группу событий, если по результатам наблюдения хотя бы одно из них обязательно происходит.

Полная группа событий обозначается, как I. Например, события А – оценка "отлично"; В – "хорошо"; С – "удовлетворительно"; D – "неудовлетворительно" образуют по определению полную группу.

Событие 0 называется невозможным, если оно не может произойти ни при каких обстоятельствах.

События А и В называются несовместимыми, если их пересечение А*В = 0 приводит к невозможному событию. математические основы абстрактной алгебры событии. нормируем эту алгебру дополнительной унарной операцией вычисления нормы р(.), где точкой обозначено любое возможное событие А, В, С.... При этом полагаем, что упомянутая норма обладает свойствами (1) и (2) из п. 3.3. В таком случае норма р(А) для любого рассматриваемого события А имеет смысл численной характеристики его степени объективной возможности или, говорят, вероятности события А.

Чем больше величина р(А), тем более вероятно наступление данного события в результате наблюдения.

Если р(А) = 1, то событие А называется достоверным, т. е. А = I. Напротив, если р (А) = 0 = min, то событие А является невозможным, т. е. А = 0.

Промежуточное положение между достоверным событием, с одной стороны, и невозможным, с другой, занимают события А, В, С..., вероятность которых больше нуля, но меньше 1. Такие события называются недостоверными, или случайными. Понятие случайного события исходит из простого допущения, что наступление этого события по результатам каждого конкретного наблюдения нельзя заранее точно предвидеть.

Именно случайные события являются главным объектом изучения современной теории вероятностей.

4.2. Основные теоремы теории вероятностей

Центральная задача теории вероятностей состоит в определении вероятности сложного события С по известным вероятностям простых событий А, В,..., его составляющим. Решение этой задачи основывается на ряде основополагающих теорем теории вероятностей.

Теорема 4.1 Сложение вероятностей.

Пусть С = А + В – объединенное событие. Тогда его вероятность в общем случае равна р(С) = р(А) + р(В) – р(АВ).

Здесь АВ – пересечение двух событий, т. е. событие, состоящее в одновременном появлении событий А и В.

Если события А и В несовместны, то их пересечение А*В = 0 –невозможное событие.

На основании сказанного делаем следующий вывод:

Следствие 1.

Если события А и В несовместны, то вероятность появления хотя бы одного из них равна р(С) = р(А) + р(В). полученный результат является частным случаем вывода из теоремы 1.

В общем случае, можно предположить, что между двумя любыми рассматриваемыми событиями А и В существует определённая взаимозависимость. В теории вероятностей указанная взаимосвязь учитывается в понятии условной вероятности случайного события. Обозначается как р(А | В): "р от А при условии В". Аналогично, р(В | А) – условная вероятность события В. Если события А и В не зависят друг от друга, то соответствующие условные вероятности оказываются равными безусловным: р(А | В) = р(А); р(В | А) = р(В).

Теорема 4.2. Умножение вероятностей.

Вероятность одновременного наступления двух случайных событий А и В в общем случае равна р(АВ) = р(А)*р(В | А), или р(АВ) = р(В)*р(А | В).

Следствие 2.

Если события А и В независимы, то выполняется равенство р(А*В) = р(А)*р(В), т. е. вероятность одновременного появления двух независимых событий равна произведению вероятностей каждого из этих событий в отдельности.

4.3. Классическое определение вероятности по

Лапласу

Если все возможные результаты опыта или наблюдения можно представить в виде полной группы n >1 попарно несовместных и равновозможных событий B1 B2...Вn, то вероятность любого другого, связанного с ними события А равна

Здесь m – число элементарных событий B1 B2...Вn, благоприятствующих событию А.

При этом событие Bi, i ≤ n считается благоприятствующим событию А, если его наступление одновременно означает и наступление события А.

Пример. Рассмотрим чёрный (непрозрачный) ящик, в котором хранятся три белых и пять чёрных шаров, всего 8. Проведём следующий опыт: наугад извлекается 1 шар. Пусть А обозначает событие извлечения шара белого цвета. Событию благоприятствуют три элементарных исхода:

B1-извлечен первый белый шар;

B2- извлечен другой белый шар;

B3- извлечен третий белый шар, т. е. m = 3

Тогда

Рассмотренная форм9 – 1827 г. г.) и обычно связана с его именем. По своей сути эта формула определяет величин относительной частоты появления события А в большой серии серии последовательных, независимых испытаний. Эта же формула, но при условии, что её знаменатель n устремлён к бесконечности, даёт ещё один вариант так называемого асимптотического определения вероятности случайного события А.

4.4. Случайная величина и её основные статистические характеристики

Величина X, способная по результатам наблюдения принимать одно из множества различных значений Х1 Х2,...Хn = {xi}, называется случайной величиной (обозначается заглавными буквами конца латинского алфавита). Исходом или результатом каждого конкретного наблюдения является равенство вида X = xi, где ![]() .

.

Указанный исход характеризуется соответствующей вероятностью рi = p(X = xi). Полученные вероятности располагаются в виде следующей таблицы.

Таблица 4.1.

{xi} | xl | x2 | … | xi | … | xn |

{pi} | p1 | p2 | … | pi | … | pn |

Представленная таблица называется законом распределения вероятностей случайной величины X ( распределяется суммарная вероятность pΣ = 1 между различными значениями случайной величины).

Замечательным свойством любого закона распределения является свойство нормирования вида Σ pi = 1 по определению достоверного события как суммы полной группы несовместных событий Аi: X = xi; i = 1, 2,..., n.

Таким образом, задать случайную величину X строго математически –это значит, во-первых, задать множество её допустимых значений{xi} и, во-вторых, задать соответствующие вероятности для каждого элемента из этого множества

Закон распределения случайной величины – исчерпывающая её характеристика. Наряду с такой универсальной формой описания случайной величины в практическом анализе используются более простые, частные варианты ее числовых характеристик. К ним в первую очередь относятся математическое ожидание и дисперсия.

Математическое ожидание случайной величины Х определяется по формуле средней статистической величины или взвешенного среднего значения вида:

Математическое ожидание характеризует среднее значение случайной величины X по результатам большой серии независимых наблюдений.

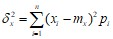

Аналогично, дисперсия случайной величины X определяется по формуле средней квадратичной величины

.

.

Дисперсия служит характеристикой интенсивности отклонения случайной величины X в серии независимых наблюдений от её математического ожидания mх. Чем больше дисперсия, тем более непредсказуемо ведёт себя случайная величина в процессе осуществляемых наблюдений. И математическое ожидание, и дисперсия – это две статистические характеристики случайной величины, дающие о ней достаточно полное представление. Во многих случаях именно такие характеристики кладутся в основу статистического анализа случайных величин и случайных процессов в самых разных их приложениях.

МАТЕМАТИЧЕСКИЕ МЕТОДЫ ОПТИМИЗАЦИИ

.1. Введение в проблему оптимальности

Проблема оптимальности – это центральная проблема теоретической информатики. Любые сколько-нибудь обоснованные выводы, решения, алгоритмы применительно к конкретной задаче могут рассматриваться как оптимальные, т. е. наилучшие в определенном смысле, если именно им отдано предпочтение на практике.

Проблема оптимальности решается путем оптимизации применяемых алгоритмов обработки информации. Любая оптимизация преследует вполне определенную цель: достижение наивысших показателей точности, надежности и эффективности алгоритмов в условиях поставленной задачи. Выбор и формулировка цели – это первый (исходный) этап в решении проблемы оптимальности.

На втором этапе выбранная цель согласуется с имеющимися возможностями или ресурсами, которыми располагает исследователь при решении проблемы оптимальности. Главное содержание этого этапа - учет ограничивающих условий или проще – ограничений на используемые ресурсы, а также выбор соответствующего математического аппарата.

На завершающем третьем этапе решения проблемы оптимальности синтезируется оптимальный при рассматриваемых ограничениях алгоритм обработки сигналов и решаются вопросы его практической реализации. Именно здесь выясняется истинная ценность различных методов оптимизации, их сравнительные преимущества и недостатки.

|

Из за большого объема этот материал размещен на нескольких страницах:

1 2 3 4 5 6 7 8 |