Пусть Х0 = (х1(0), …, хп(0)) — начальная точка поиска (рис. 9.4, а).

Рис. 9.4. Поиск экстремума квадратичной функции методом покоординатного спуска (а), методом параллельных касательных (б), методом наискорейшего спуска (в) и методом сопряженных градиентов (г)

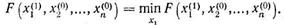

Результат первой итерации X1 получается из Х0 при выполнении однопараметрической оптимизации по параметру x1, т. е.

Х1 = (х1(1), х2(0) …, хп(0)),

причем

Результат второй итерации Х2 получается из X1 путем оптимизации F(X) по параметру х2 и т. д. Далее процесс продолжается из точки Xп снова путем варьирования параметра х1 и т. д. Величину шага αk выбирают по способу оптимального шага.

Величина r за один цикл поиска равна размерности пространства, т. е. r = п.

Модификацией алгоритма покоординатного спуска является метод ортогональных направлений (метод Розенброка), который основан на вращении системы координат в соответствии с изменением скорости убывания критерия оптимальности. При этом направление одной оси соответствует наиболее вероятному направлению скорейшего убывания на данной итерации критерия оптимальности, а остальные находятся из условия ортогональности.

Если в задаче оптимального консультирования поверхность отклика ограничена концентрическими эллипсоидами, то точное местоположение оптимума не более чем за (2п—1) одномерных итераций позволяет получить метод параллельных касательных. Идея этого метода для п=2 иллюстрируется на рис. 9.4, б.

Метод заключается в поиске центра системы концентрических эллипсов. Первоначально определяют направление касательной π0 из точки Х0 к линии уровня (точка X1), затем строят произвольную прямую π1, параллельную π0, и на ней точку Х2, соответствующую точке касания π1 и линии уровня. Местоположение центра X* определяется путем поиска вдоль линии X1X2.

Метод параллельных касательных пригоден для поиска оптимума на любой унимодальной функции, требует небольшого количества информации, но сопряжен с громоздкими вычислениями.

Градиентные методы. Методы поиска, в которых направление движения от итерации Xk-1 к Xk определяется градиентом (антиградиентом), вычисленным в точке Xk-1, носят название градиентных методов.

Наиболее применяемым из методов минимизации является метод наискорейшего спуска. В большой степени широкому распространению метода способствуют его сравнительная простота и возможность применения для минимизации весьма широкого класса функций. При определении направления поиска выбирают наибыстрейшее убывание целевой функции F(Х), т. е.

Pk=-gradF(Xk-1).

Работа метода заключается в следующем. После определения градиента критерия оптимальности в точке Xk движутся вдоль направления антиградиента до точки, в которой достигается минимальное значение функции. Затем в этой точке снова определяют градиент и движутся по прямой согласно направлению нового антиградиента и т. д., пока не достигнут точки, имеющей наименьшее значение функции F(X). На рис. 9.4, в приведен пример движения при поиске методом наискорейшего спуска оптимума для критерия оптимальности, зависящего от двух переменных. Направление

grad F(Xk-1) является касательным к поверхности уровня в точке Xk, и, следовательно, grad F(Xk) в точке Xk-1 ортогонален grad F(Xk-1).

Простейшим среди градиентных методов является метод, при котором движение из точки Xk-1 осуществляется по антиградиенту с постоянным шагом αk=const.

Если окажется, что F(Xk)>F(Xk-1), то для определения экстремума используют один из возможных алгоритмов поиска с возвратом. Так, в частности, поиск может производиться путем возврата в точку Xk-1 и дальнейшего перемещения из этой точки вдоль антиградиента с шагом α/2. Процедура дробления шага производится до тех пор, пока его значение не станет меньше некоторого малого положительного числа ε.

Описанные варианты реализации градиентного метода отличаются друг от друга способом выбора длины шага. Скорость сходимости этих методов примерно одинакова, а трудоемкость каждой итерации вариантов процесса (9.42) различна только в способах определения параметра αk. Как правило, вычисления градиента в меньшем числе точек требует метод наискорейшего спуска.

Градиентные методы эффективны для решения задач минимизации гладких и выпуклых функций. В практике автоматизированного консультирования для ускорения сходимости решения задач оптимизации градиентные методы следует использовать в комбинации с другими, более эффективными на начальной стадии решения задачи.

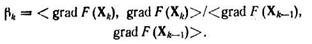

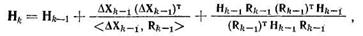

Метод сопряженных градиентов. В градиентных методах для поиска экстремума использовались свойства ортогональности векторов. В методе сопряженных градиентов оптимум целевой функции ищется на основе свойств орготональности приращений вектора градиентов. Для этой цели наряду с градиентом используют матрицу Гессе Г критерия оптимальности. С помощью матрицы Г удается выбрать направление поиска, наиболее полно учитывающее особенности критерия оптимальности. Напомним, что векторы А и В называют сопряженными относительно симметричной и положительно определенной матрицы Г, если скалярное произведение векторов А и ГВ равно нулю, т. е. <А, ГВ>=0. Направление поиска Рk+1 на k+1-м шаге определяется как

![]()

где

Если критерий оптимальности представлен квадратичной функцией, то минимум функции достигается ровно за п шагов (рис. 9.4, г). В случае критерия оптимальности произвольного вида метод позволяет для заданной погрешности получить приближенное решение быстрее, чем это позволяют сделать методы наискорейшего спуска и параллельных касательных.

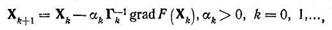

Методы Ньютона и переменной метрики. Ускорение поиска экстремума связано с улучшением выбора сопряженных направлений. Довольно эффективным является поиск сопряженных направлений с одновременным накоплением информации о матрице Гессе критерия оптимальности. Используют соотношение

которое является формулой метода Ньютона с регулировкой шага. Обычный метод Ньютона соответствует случаю αk=l.

Метод Ньютона с регулировкой шага сходится к решению независимо от выбора начальной точки Х0 и обладает либо линейной, либо квадратичной скоростью сходимости в зависимости от вида функции F(X). В обычном методе Ньютона сходимость гарантируется лишь при наличии достаточно хорошего начального приближения.

При решении задач минимизации выпуклых функций метод Ньютона обеспечивает более высокую скорость сходимости последовательных приближений к решению по сравнению с градиентными методами, однако количество вычислений на итерации метода Ньютона высоко за счет необходимости вычисления и обращения матрицы вторых производных. Минимизация квадратичных функций происходит за один шаг.

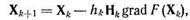

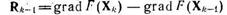

На основе метода Ньютона разработан эффективный метод, получивший название метода переменной метрики. Идея метода заключается в использовании информации о градиенте критерия оптимальности для приближенного вычисления матрицы Гессе. Этот метод — итерационный. Поиск в нем ведется по формуле

где Нk — приближенно вычисляемая обратная матрица Гессе; hk — величина шага, определяемая одномерной минимизацией целевой функции на луче— Нk grad F (Xk).

Главное преимущество метода переменной метрики перед методом Ньютона — отказ от вычислений матрицы Гессе на каждой итерации. Положительно определенная матрица

где ∆Xk-1 — приращение вектора переменных консультирования на предыдущем (k—1)-м шаге, имеет форму вектор-столбца; (∆Xk-1)T— транспонированный вектор ∆Xk-1, т. е. вектор-строка;

— вектор-строка.

В начале вычислений нужно задаться произвольной положительно определенной матрицей Н0, в частности Н0 может быть единичной матрицей. Шаг hk выбирают по методу одномерной оптимизации.

Ввиду того что в методе переменной метрики достаточно полно учитывается локальная информация, его целесообразно применять в окрестности оптимального решения.

Методы одномерной оптимизации. Эти методы позволяют найти оптимум для функций одной переменной. Они не требуют условия дифференцируемости критерия оптимальности, а требуют только его непрерывности. Среди этих методов наиболее распространены методы чисел Фибоначчи, золотого сечения и полиномиальной аппроксимации. Для их применения необходимо знать интервал [а, b] переменной х, на котором функция F(х) имеет единственный минимум.

При применении метода чисел Фибоначчи должно быть зафиксировано число точек N, в которых производится вычисление критерия оптимальности.

|

Из за большого объема этот материал размещен на нескольких страницах:

1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95 96 97 98 99 100 101 102 103 104 105 106 |